VPD(垂直供电),在最近这拨AI热中彻底被带火了。

今年CES上,英伟达确定Rubin会用VPD方案。根据英伟达的说法,Rubin架构将搭载更宽、更多的HBM4显存,HBM因为已经占据了GPU封装周围所有空间,物理位置已经没有给横向供电(LPD),因此VPD是确定性方案。

无独有偶,英特尔、谷歌也都已开始尝试VPD方案。甚至,华为也在关注这项技术,华为有一项关于“芯片垂直供电系统”的发明专利申请,该专利旨在提供一种为芯片供电的电压调节模块(VRM)设计方案。

可以说,VPD将会是现代处理器最关键的技术之一。那么,这项技术有哪些值得关注的细节,哪些厂商在布局这项技术?今天EEWorld将进行详细的解析。

为什么必须是VPD

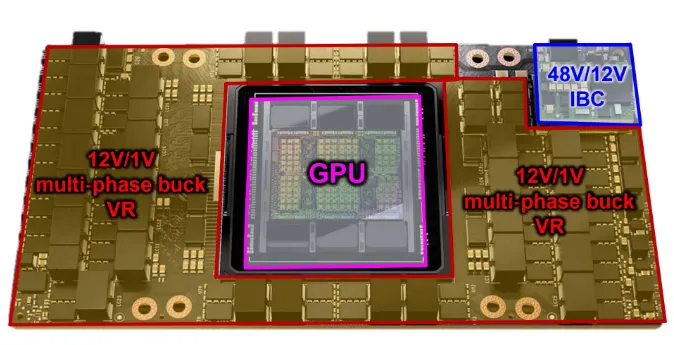

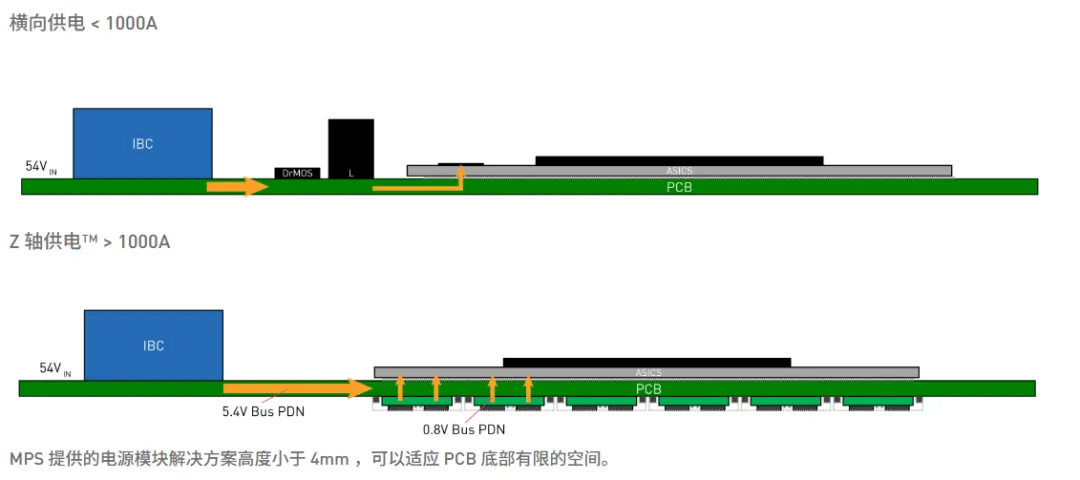

长期以来,处理器的供电任务一直由环绕在芯片封装四周的多相电压调节器承担,如下图所示,便是常见的横向供电(LPD)。其提供了两级供电系统:第一级为非稳压IBC,将48V降压至IBV;第二级由多个VR构成,为GPU不同域提供精确稳压和调频功能,同时满足瞬态要求。

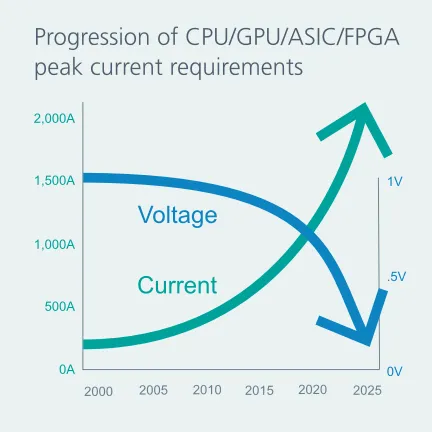

尽管这一方案技术成熟、久经考验,却受制于基础物理定律。随着处理器工作电流不断攀升,供电网络(PDN)内的电阻和电感效应所引发的功率损耗也随之加剧。

英伟达的Hopper GPU横向供电架构

即便采用了先进的主板设计与电源优化技术,这种“横向供电” 模式仍会在处理器与本地电源之间形成漫长且曲折的电流路径。一方面,这些路径会产生额外的寄生参数,不仅降低了供电效率,还会劣化瞬态响应能力,而对于电流需求瞬息万变的AI工作负载而言,瞬态响应恰恰是决定性能的关键。另一方面,当前板上的空间愈发局促,把电源模块放在垂直方向上,也可以给HBM等关键部件让出空间。

传统的多相稳压器的横向供电方式,在突破1000A门槛时,功率损耗问题就开始凸显。随着GPU和TPU等AI处理器尺寸不断变大,新一代AI处理器现在要求核心电压在当前2000A到5000A甚至更高的水平。根据行业预测,其但随着芯片尺寸的不断增大、供电电压降至约0.4 V,其总电流消耗预计将在十年内攀升至10000 A。

VPD应运而生。

看懂VPD

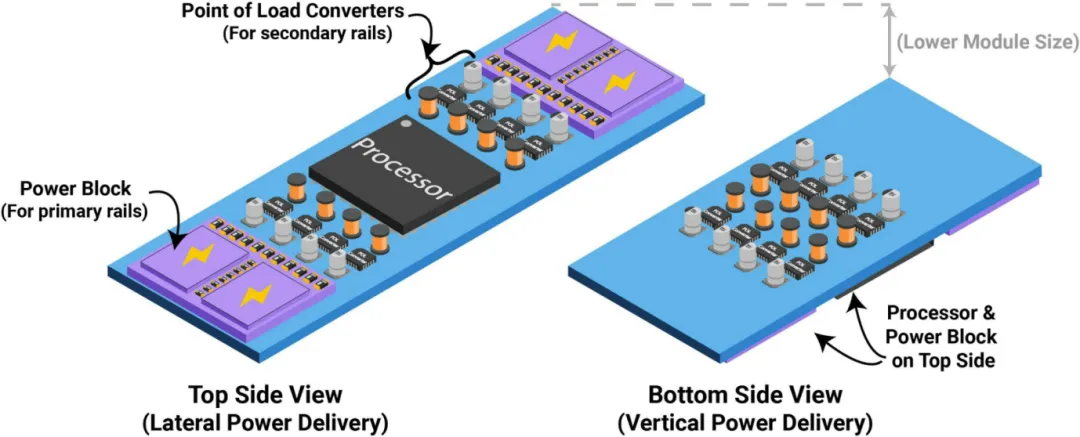

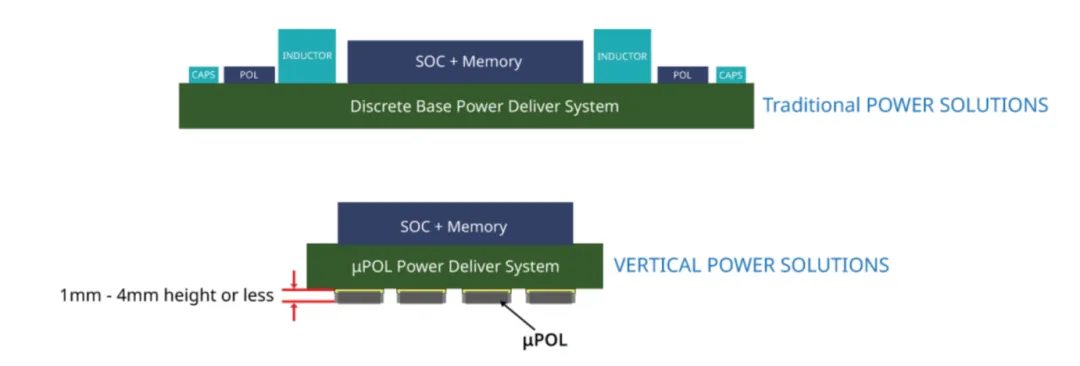

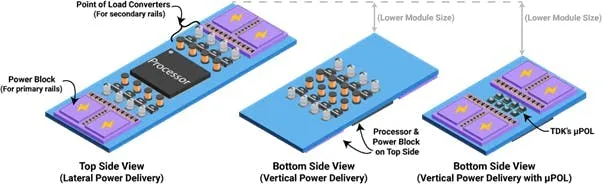

垂直供电架构(VPD)很容易理解,即通过穿透PCB层垂直向上输送电力,直接给上方的处理器供电,从而有效缩短了从VRM到SoC的电力传输距离。

实现这一目标的核心手段之一,是将POL直接放置在PCB背面、处理器正下方,以此缩短次级供电轨的长度。

相较于传统横向供电,垂直供电(VPD)具备多重关键优势:

电阻损耗更低:更短、更直接的供电路径天然降低了电阻,有效减少I²R损耗,在减少额外发热的同时,为处理器输送更多有效功率;

瞬态响应更好:更少的路径断点与更短的供电回路,让VPD实现更快的瞬态响应,这对电流需求剧烈波动的现代处理器至关重要;

信号完整性更好:将高频开关组件移至主板背面,并在PCB中集成屏蔽层,可隔离敏感信号层与供电噪声;同时保留顶层更多连续铜箔,提升高速信号性能与电磁兼容性(EMC),这在高密度服务器环境与共封装光互连场景中尤为关键;

空间优化:释放主板正面空间,使设计人员能在处理器周边集成更多内存、光模块与系统级功能,在不增加板卡面积的前提下,实现更高内存带宽、更多处理资源与扩展系统特性;

可扩展性:VPD通过减少长距离的当前路由来提升可扩展性;

更好释放处理器性能:降低PDN阻抗、提升瞬态响应,可直接满足AI核心对小于1V 的严苛电压容差要求,更快的调节速度意味着更稳定的运行、更少的电压跌落与降额,从而释放处理器的全部性能。

虽然VPD前景广阔,但会带来更多工程难题,整个供电模块都需要重新设计,这些问题主要包括:

散热压力:高性能计算的电流密度已达3~4 A/mm²,在处理器下方的狭小空间内实现这一功率水平,需要高度集成的多层模块设计,结合先进磁芯、平面电感技术与优化的开关拓扑;

高度限制:VPD模块位于PCB与系统机箱之间,z轴高度通常被限制在2mm以内;

热隔离问题:传统设计中,处理器与调节器共享正面散热系统,而VPD将调节器置于主板背面,与系统散热器和气流形成热隔离。要在保持高电流吞吐的同时应对这一问题,需要创新的封装设计、均热材料,甚至局部主动散热方案;

热区重叠:供电模块与处理器的x-y平面footprint重叠,使两个热源集中在同一区域,加剧了散热挑战,增加了性能下降或故障风险。

行业正通过先进封装、超薄磁性材料与热界面技术创新,推动VPD规模化落地。

从背面供电,到基板供电

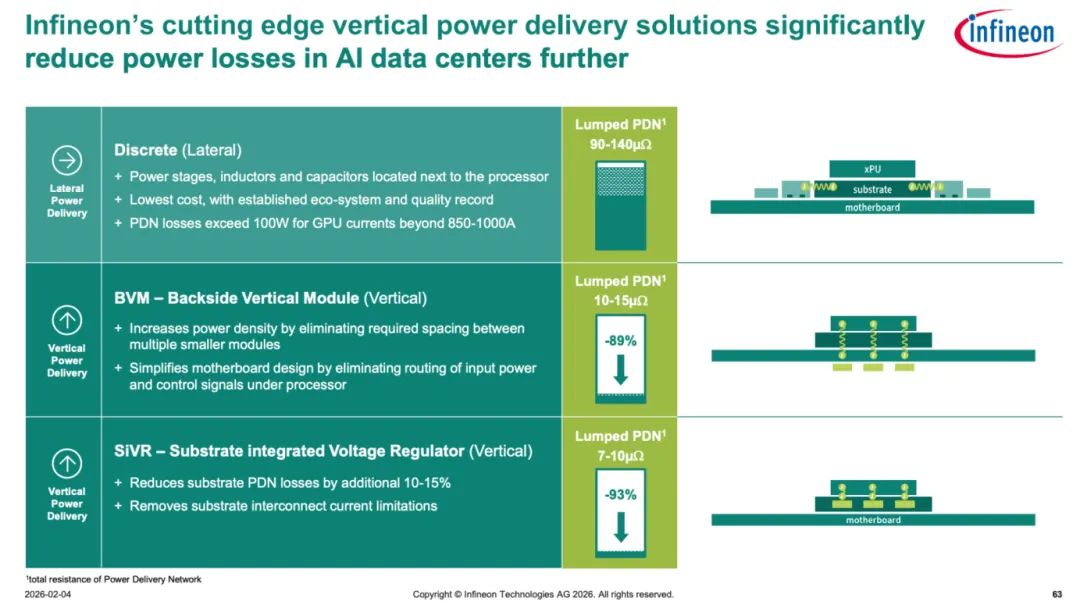

事实上,除了把供电模块放在背面,VPD还有一种更优解,就是把供电模块直接放在基板上。英飞凌就曾在2月4日发布的技术简报展示了一个发展路线图。

第一阶段是离散/横向供电(Discrete/Lateral),功率级、电感、电容直接布置在处理器(GPU)旁边,成本最低,生态与质量体系成熟。不过,GPU电流超850~1000A 时,损耗会超过100W,PDN总电阻约为90~140μΩ。

第二阶段是背面垂直供电(BVM),采用垂直布局,顾名思义,供电模块采用垂直穿透布局,从基板/主板背面垂直对接处理器,缩短传输路径。通过消除多个小型模块间的间距,移除处理器下方的电源/控制信号布线,提升功率密度,简化主板设计,大幅降低PDN总电阻至10~15μΩ(比横向低89%)。

第三阶段是基板集成电压调节器供电(SIVR),将电压调节器直接集成在基板上,垂直传输路径进一步精简,是损耗控制的最优解。能够额外减少10~15%的基板PDN损耗,PDN总电阻达到7~10μΩ(比横向低93%)。英飞凌在2023年就提出过这样的概念,不过这些迭代主要靠处理器厂商牵头来做,目前背面垂直供电刚刚进入大规模商业化阶段。

哪些厂商在布局VPD

Vicor

Vicor 在VPD的布局很早,也是英伟达确认的合作伙伴之一,在CES英伟达公布Rubin采用VPD架构后,Vicor成为了最大受益者,股市也相当活跃。有报道指出,48V AI系统应用中,Vicor曾一度占据高达85%市场份额,合作伙伴包括英伟达、谷歌、英特尔、AMD、Cerebras、Tesla等。

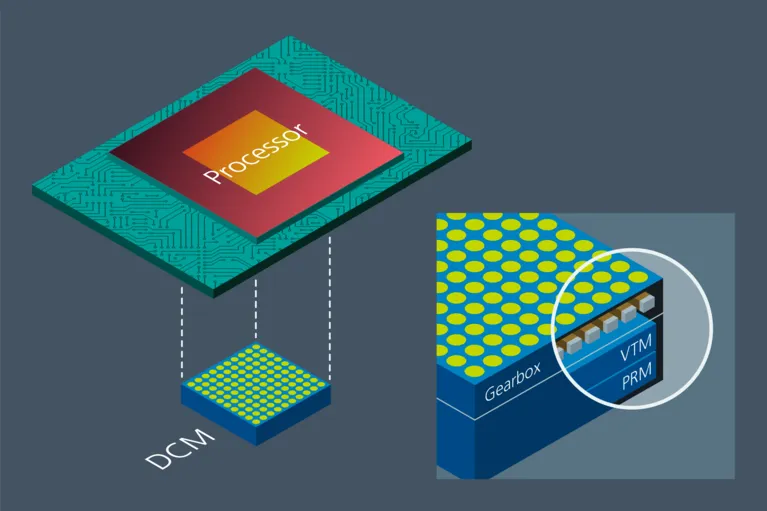

Vicor的VPD解决方案是一个由三层组成的集成模块:下层是一个Gearbox,中间层是 VTM电流倍增器阵列,上层是PRM稳压器,这样的三层组成了一个完整的VPD解决方案,Vicor称之为DCM。

Gearbox执行两个功能:一是包含高频去耦电容,二是把来自VTM的电流重新分配形成与上面的处理器镜像一致的模式。VTM阵列的大小取决于处理器输入电流要求,PRM的大小取决于总的功率需求。如果GPU或ASIC需要多个电源轨,则VTM层和PRM层可以分别使用独立的PRM和VTM来实现,其大小可以满足每个特定轨的电流和电压要求。

Vicor VPD方案通过将MCM/GCM电流倍增器直接置于处理器下方,把PDN电阻进一步降至5~7 µΩ,最大化发挥AI处理器的算力与能效。根据Vicor的垂直电源传输方式可将PDN损耗降低 95%。

Infineon

去年3月,Infineon(英飞凌)推出OptiMOS TDM2454xx四相功率模块,实现了真正的垂直供电(VPD),并提供行业领先的2安培/平方毫米电流密度。此模块延续了英飞凌2024年推出的OptiMOS TDM2254xD和TDM2354xD双相功率模块,继续为加速计算平台提供卓越的功率密度。

英飞凌表示,在传统水平供电系统中,电流需要流经半导体晶圆表面,这导致了电阻增加并产生了明显的功率损耗。垂直供电通过缩短电流传输路径,减少电阻损耗,从而提升系统效率。

通过采用英飞凌强大的OptiMOS 6沟槽式技术功率组件和嵌入式芯片封装,OptiMOS TDM2454xx模块可以提供优异的电气和散热性能,同时运用创新的超薄电感设计技术,不断提高VPD系统性能和质量的极限。此外,OptiMOS TDM2454xx的结构设计有利于模块化拼接,且能改善电流传导,进而提升电气、散热和机械性能。该模块在四相电源中最高支持280A电流,并在仅10x9 mm²的小型封装内整合了嵌入式电容层,结合英飞凌的XDP控制器,可实现稳定耐用的高电流密度功率解决方案。

MPS

MPS(Monolithic Power Systems)在VPD布局也很积极,有报道称MPS在H100 GPU供电方案中有相当一部分应用。不过,MPS的VPD方案名字不太一样,叫“Z轴供电”(ZPD)。Z轴供电将稳压器放置在PCB底部、处理器的下方。这种方法可以显著降PDN损耗(超过10倍)。

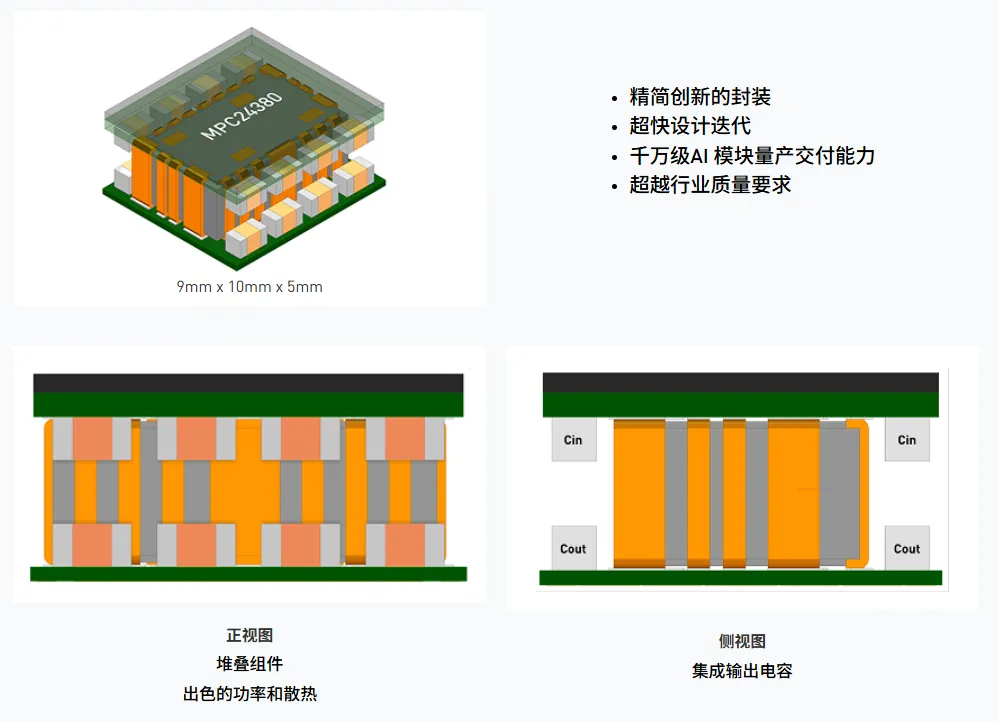

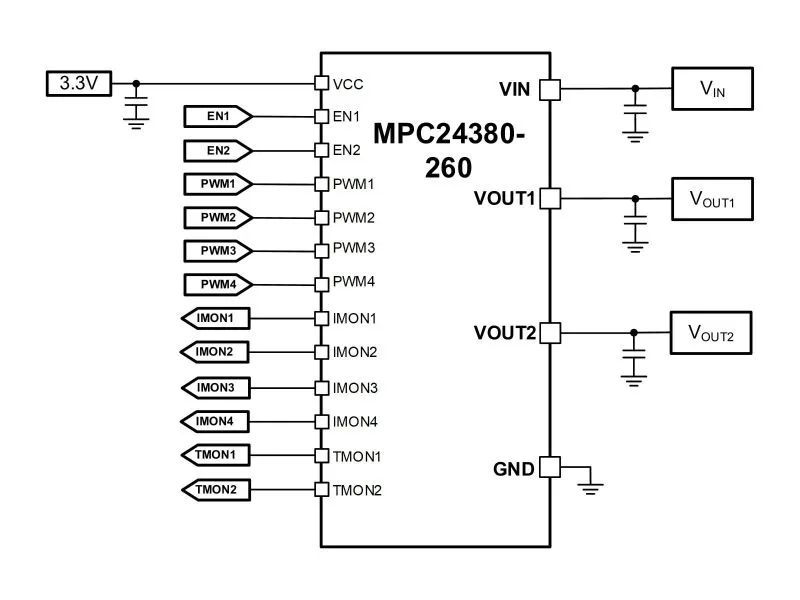

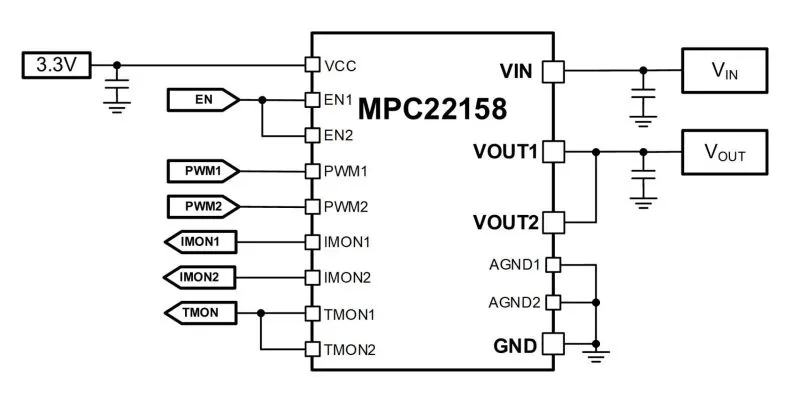

去年,MPS针对AI服务器需求,推出新一代超高功率密度AI电源方案,其核心产品MPC24380采用Z轴供电架构,集成输出电容,搭配DrMOS顶置设计优化散热,具有四路260A高输出电流以及2A/mm2 超高功率密度等亮眼优势;同时也推出了不同规格的MPC22158,超小体积实现两路130A输出电流,以高效率高集成度等多重优势助力AI芯片供电,破解能源与散热困局。

ADI

ADI(亚德诺半导体)也在研究类似VPD的结构,不过当前还没有更多进展。ADI研究出了一种Notch CL(NCL)结构的新型耦合电感,以优化极低输出电压和激进负载瞬态规格的应用性能。

NCL可以放置在PCB底部,正好在GPU陶瓷旁路上方,电源级环绕NCL的周边。这种方法类似于垂直电力传输(VPD)布置,可能增强瞬态与波纹之间的权衡(实际上是瞬态效率)。不过,ADI表示,实施这样的改变将是对现有设计和布局的重大转变。未来是否考虑这一方案将取决于客户偏好。

TDK

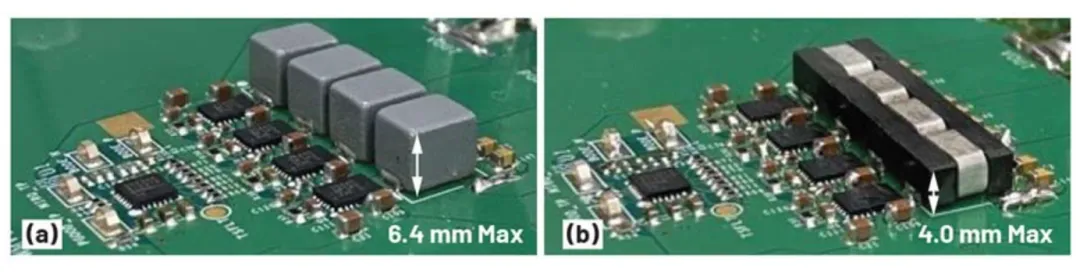

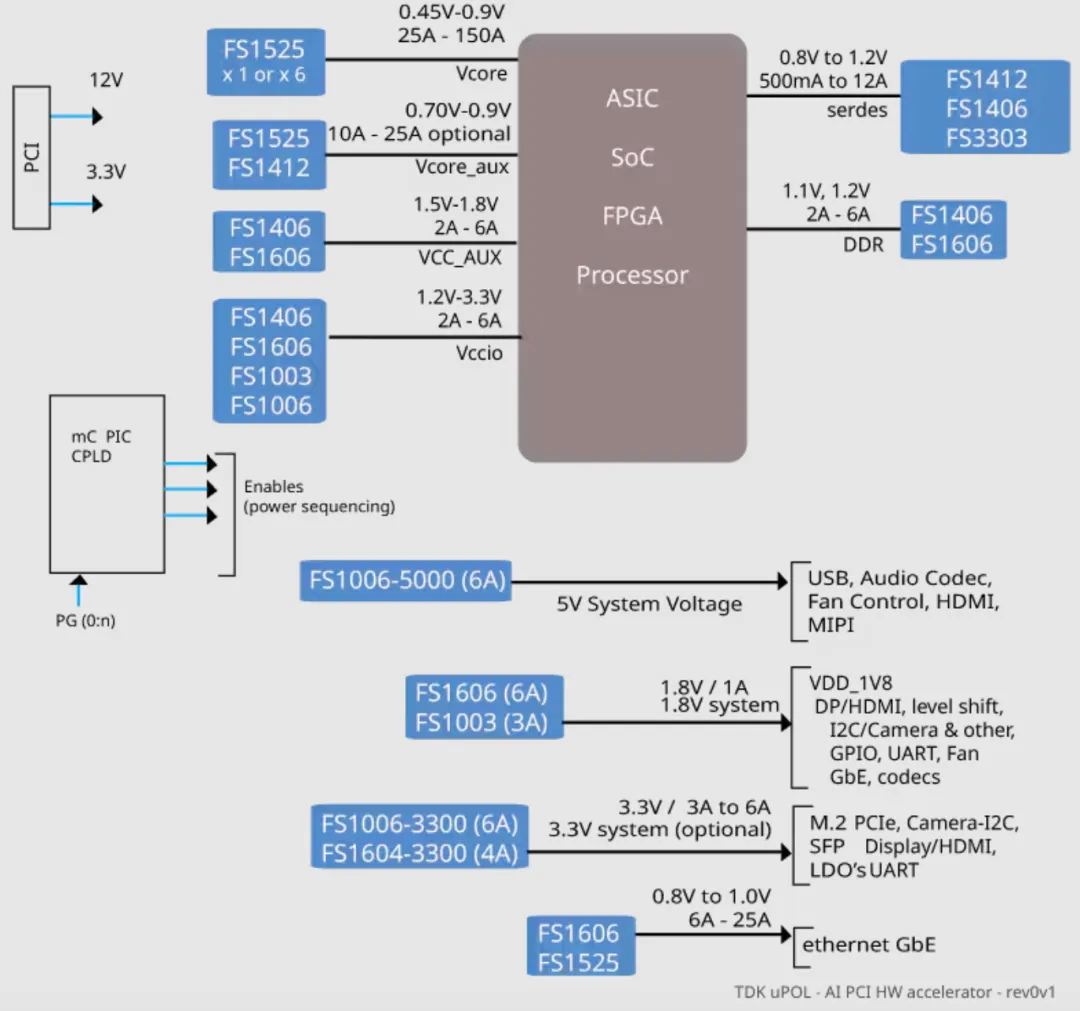

TDK也在布局VPD。其推出的的μPOL直流变换器采用芯片嵌入技术SESUB,以实现最佳紧凑尺寸,非常适合这些应用的1A至200A垂直电源。

TDK的FS1525集成了功率电感,以平滑μPOL将功率推入负载时产生的电流纹波。这种集成通过减少寄生效应,实现了更小的形态和更高的效率。通过将所有元件压缩到一个小型电源模块中,DC-DC可提供每立方厘米127安培的功率密度。

该模块实现了一种更先进的调制方式,称为自适应时间调制(AOT),实现超快瞬态响应,并实现内部环路补偿。基于锁相环(PLL),该调制方案在15安培和25安培下分别实现了91%和89%的效率。此外,I2C和PMBus为工程师提供了额外的遥测选项。

Empower Semiconductor

Empower Semiconductor是谷歌投过的一家电源芯片公司。去年6月,Empower Semiconductor宣布与 Marvell 展开深度合作,联合研发集成式电压调节器(IVR)及垂直供电(VPD)架构,核心目标是将传统板级电压调节设计,升级为硅基集成或近芯片供电解决方案,以此应对千瓦级芯片时代下的各类供电难题。

总结

目前,数据中心的能耗占全球能耗的2%以上。在人工智能的推动下,数据中心的功率需求预计将在2023年至2030年间增长165% 。要进一步提高计算性能,同时降低总体拥有成本(TCO),不断提高从电网到核心的功率转换效率和功率密度至关重要。

多重压力下,VPD以更短供电路径、更低PDN阻抗、更优瞬态响应、更省板上空间,成为支撑高算力、高集成度AI芯片的关键支撑。可以预见,这项技术,将会逐渐成为市场标配。

上一篇:EPC与瑞萨签署氮化镓全面授权协议

下一篇:最后一页

推荐阅读最新更新时间:2026-03-25 07:54

- 麦米电气采用英飞凌CoolMOS™ 8 MOSFET驱动其新一代AI服务器

- 面向数据中心备电系统的电池检测新路径:EIS技术加速走向规模化应用

- Bourns 全新推出符合 AEC-Q200 标准车规级半屏蔽功率电感

- 工业级电动工具控制:电源管理与信号采集解决方案

- 德州仪器推出高性能隔离式电源模块,助力数据中心和电动汽车提高功率密度

- GM6402:40V/2A 高效降压模块,LTM8074 最佳替代,芯片涨价潮中,共模好芯不涨价

- Power Integrations将反激拓扑功率范围扩展至440W,打造比谐振设计更简洁的电源方案

- Vishay新款光电晶体管光耦合器提高工业应用的精度和能效

- 瑞萨电子推出全新GaN充电方案, 为广泛的工业及物联网电子设备带来500W强劲功率

- 用于 7VIN 至 16VIN、1.5V 和 1.2V 输出的 LTM4628EV DC/DC 模块稳压器的典型应用电路

- 使用 Analog Devices 的 LTC3728LIGN 的参考设计

- DER-406 - 适用于 A19 灯的 5.76 W 高 PF 非隔离降压-升压型 TRIAC 调光 LED 驱动器

- ADR5045B 5V 输出精密微功率并联模式电压基准的典型应用

- LT3970EDDB-3.42 2.5V 降压转换器的典型应用

- MC78M08BDTG 8V 电流调节器的典型应用

- LT1021DCN8-5 精密电压基准的典型应用

- DER-282 - 100W, 扁平(11 mm), LLC DC-DC转换器

- REF193 低压差开尔文连接电压基准的典型应用电路

- LT3088EM 线性稳压器用于添加软启动的典型应用

华为eNSP的介绍与简单使用

华为eNSP的介绍与简单使用 《华为项目经理晋级之道-研发项目管理高级实战》

《华为项目经理晋级之道-研发项目管理高级实战》 斯坦福大学Mobile ALOHA 机器人开源资料

斯坦福大学Mobile ALOHA 机器人开源资料 华为HCIA-Datacom V1.0 培训材料-PPT

华为HCIA-Datacom V1.0 培训材料-PPT 非常经典的关于LLC的杨波博士论文

非常经典的关于LLC的杨波博士论文

XC6406PP60DL

XC6406PP60DL

京公网安备 11010802033920号

京公网安备 11010802033920号