12 月 12 日消息,谷歌今天(12 月 12 日)发布博文,宣布正式向 Google Cloud 客户开放第六代 TPU Trillium,希望凭借大的计算能力、高效的性能和可持续特性,更好推动 AI 模型发展。

Trillium TPU 是 Google Cloud AI 超级计算机(AI Hypercomputer)的关键组件,是一种突破性的超级计算机架构,采用了一个由性能优化的硬件、开放软件、领先的机器学习框架和灵活的消费模型组成的集成系统。

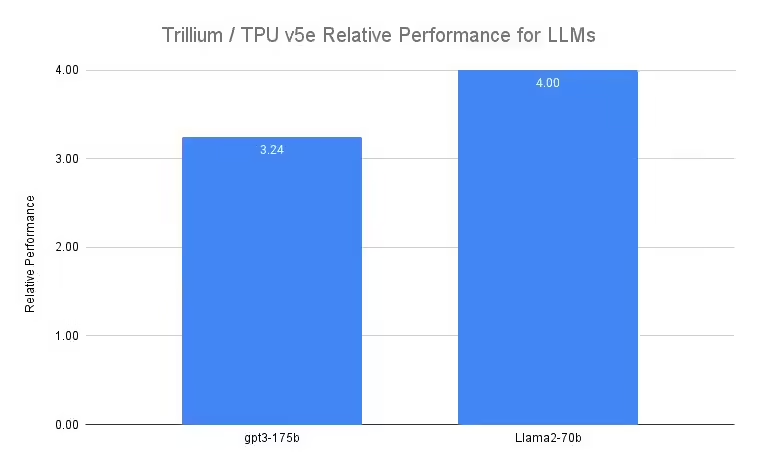

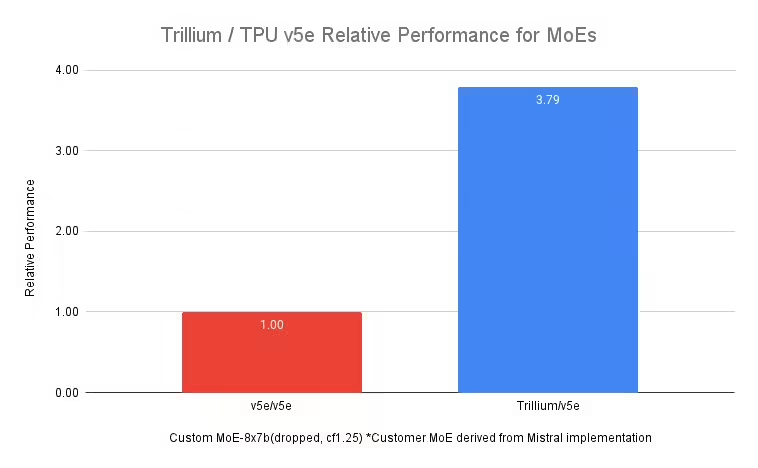

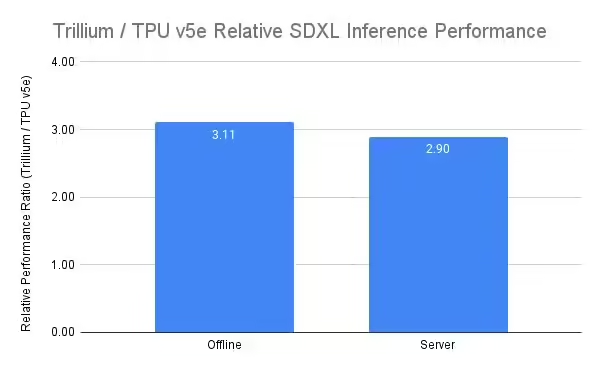

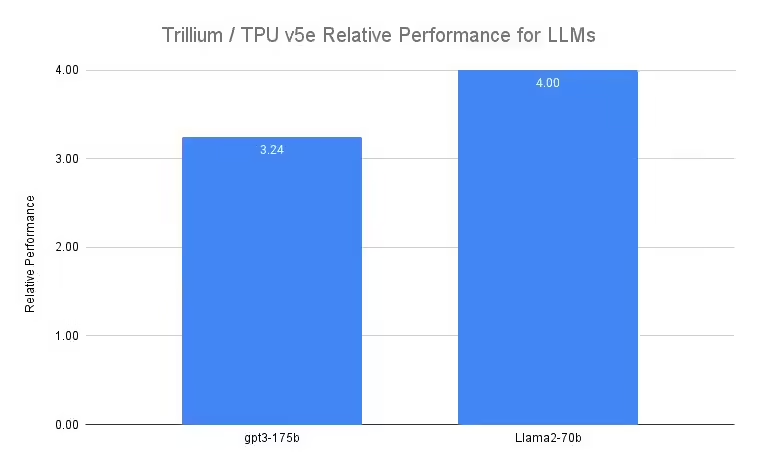

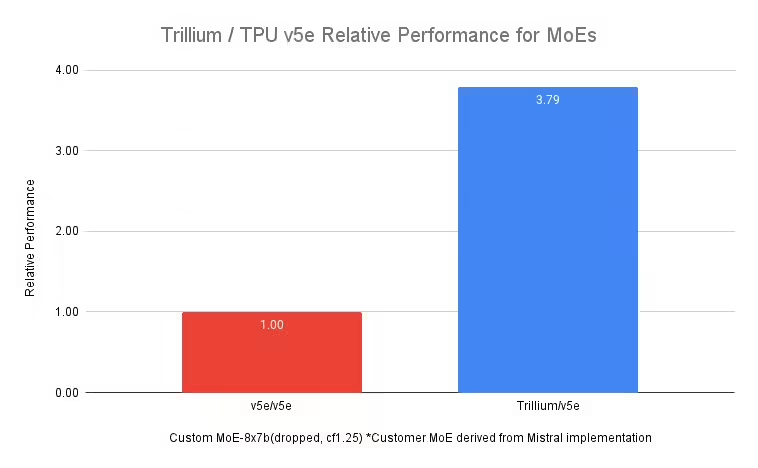

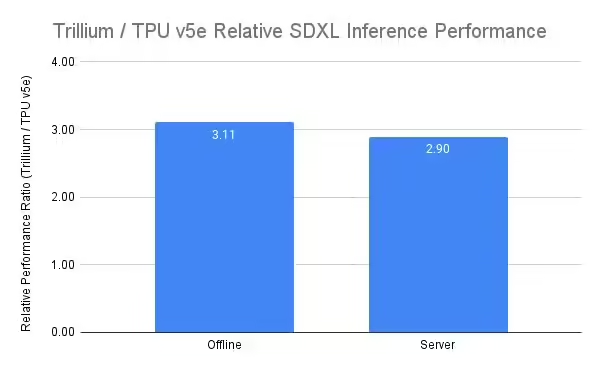

今年 5 月,在 I/O 开发者大会上,谷歌正式宣布 Trillium TPU。官方称相比上一代,Trillium TPU 在训练性能上提升 4 倍以上,推理吞吐量提升高达 3 倍,峰值计算性能提升 4.7 倍。

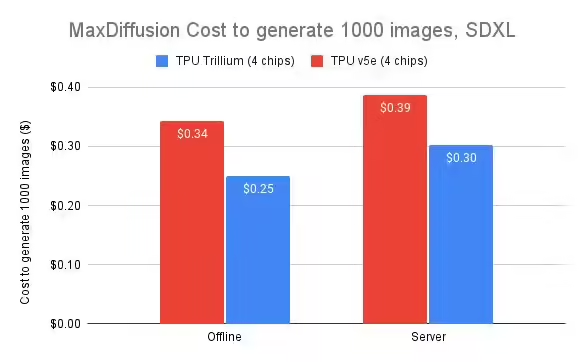

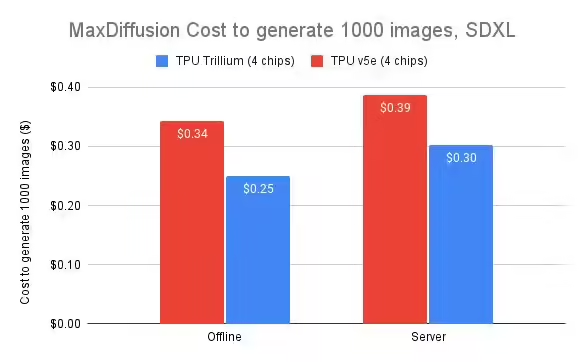

在效率方面,Trillium TPU 能源效率提高 67%,每美元训练性能提升高达 2.5 倍,推理性能提升高达 1.4 倍。

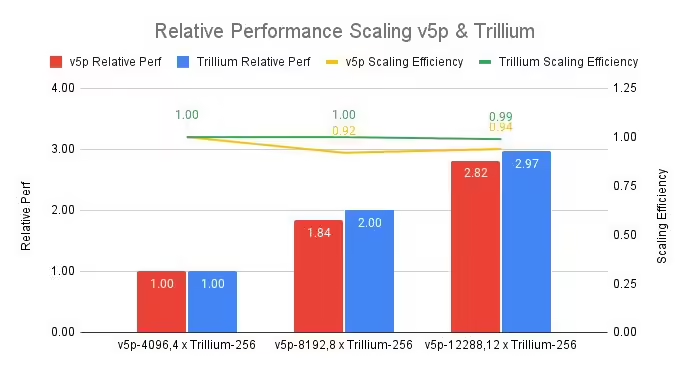

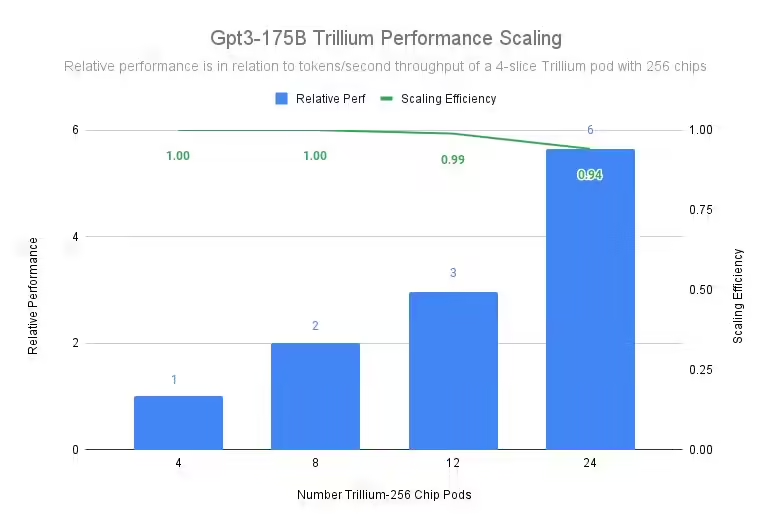

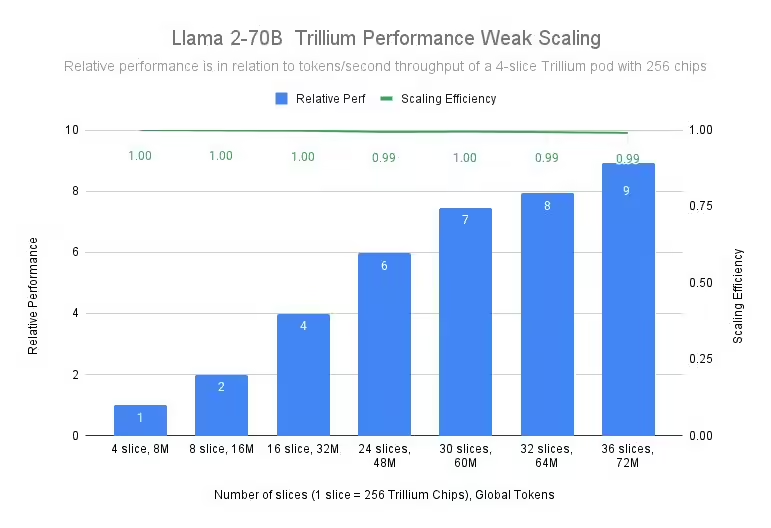

在规模扩展方面,单个 Jupiter 网络结构可容纳 10 万个 Trillium 芯片,双倍的 HBM 容量和 ICI 带宽,支持大规模 AI 训练。

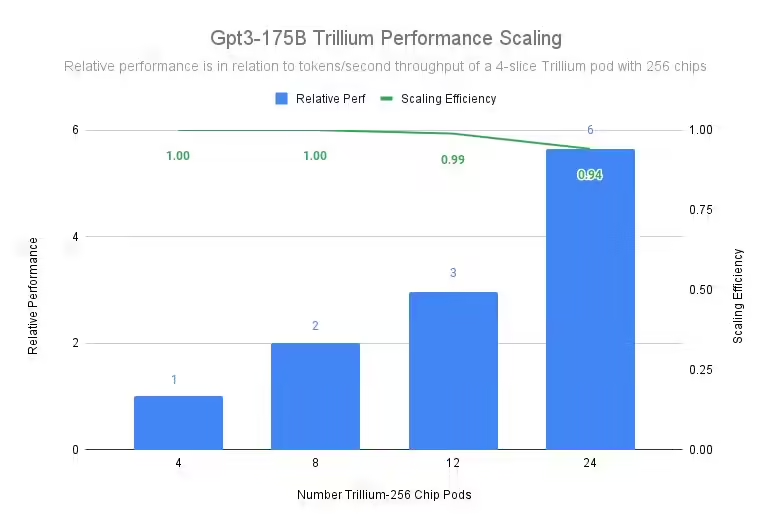

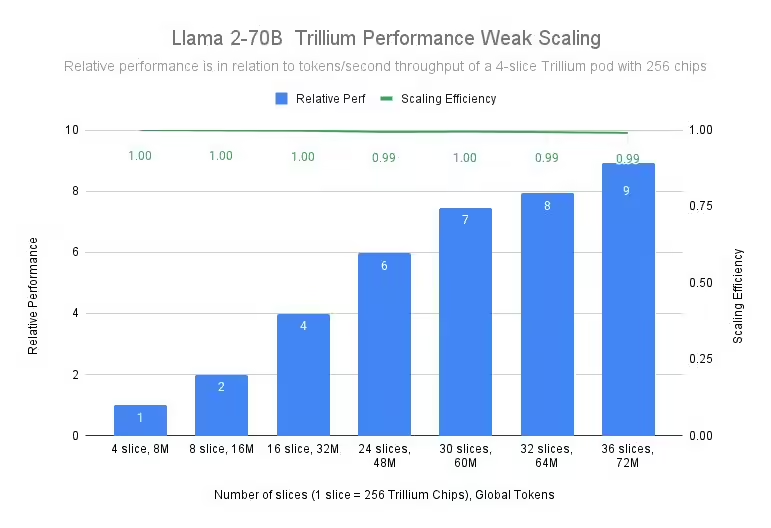

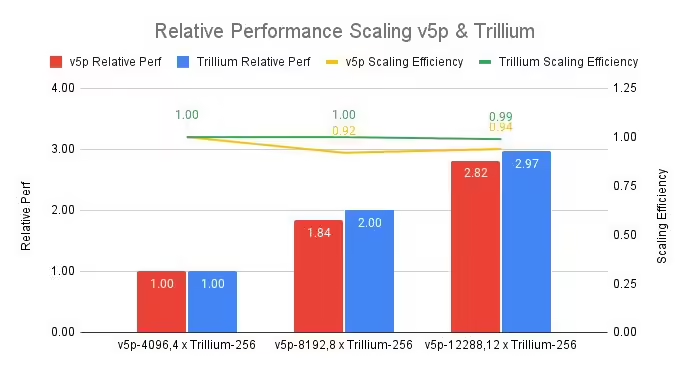

官方称 Trillium 近乎线性的扩展能力,配合高速芯片互连和 Jupiter 数据中心网络,显著加快大型模型训练速度,在训练 gpt3-175b 模型时,即使跨数据中心网络运行,24 个 Pod(6144 个芯片)也能达到 94% 的扩展效率。

关键字:谷歌 TPU

引用地址:

谷歌最强 TPU Trillium 芯片商用:性能提升 4.7 倍、内存带宽翻番、节能 67%

推荐阅读最新更新时间:2026-03-20 20:06

消息称 Anthropic 将直接从博通采购近 100 万颗谷歌 TPU v7 AI 芯片

1 月 4 日消息,半导体与 AI 行业研究分析公司 SemiAnalysis 北京时间昨日表示,AI 企业 Anthropic 将直接从博通采购近 100 万颗 TPU v7p Ironwood AI 芯片,本地部署在其控制的数据中心中。 换句话说,博通将直接向 Anthropic 供应基于 TPU v7p 的机架级 AI 系统,“绕过”TPU 芯片的另一开发参与方谷歌。不过谷歌预计仍可从 Anthropic 同博通的交易中取得 IP 授权收入。 博通 CEO 陈福阳此前在 2025 年 12 月确认,Anthropic 已累计向博通下达了价值 210 亿美元(现汇率约合 1471.78 亿元人民币)的 AI 系统订单。 在 A

[半导体设计/制造]

谷歌AI芯片获大单:Anthropic将使用100万个TPU训练大模型

北京时间10月24日,据路透社报道,AI创业公司Anthropic周四表示,其Claude大模型将使用多达100万个谷歌AI芯片进行训练,这些芯片价值数百亿美元。Anthropic希望借此在快速发展的AI领域提升其生成式AI产品的性能。 作为Anthropic的投资者之一,谷歌还将为Anthropic提供额外的云计算服务。这项交易凸显了生成式AI在训练、部署以及持续推理过程中对算力的巨大需求。 对谷歌而言,这笔交易正值其扩大自研张量处理单元(TPU)对外可用性之际,这些芯片过去主要用于内部。谷歌目前通过其云服务向外出租TPU。 Anthropic表示,之所以选择TPU,是因为其性价比高、效率优越,而且公司此前已有使用这些处理器训练

[半导体设计/制造]

消息称谷歌正打破 TPU 完全自托管局面,强化与英伟达 AI 芯片竞争

9 月 4 日消息,谷歌自研 AI 芯片 TPU 张量处理器已有多年历史、历经数次迭代,其不仅支持谷歌自身 AI 业务,还以 Google Cloud 上的云端算力形式提供给 OpenAI 等合作方。 谷歌的 TPU 芯片迄今为止仍然完全在自家数据中心托管,未部署到外部物理环境中。不过根据外媒 The Infomation 的报道,这一局面即将被打破。 ▲ 谷歌 TPU v7p Irodwood 最新报道指出,谷歌近期正与主要对外租赁英伟达 AI GPU 的小型云服务供应商展开谈判,希望这些企业在数据中心也托管部署谷歌的 TPU 芯片。谷歌已与至少一家合作方(Fluidstack)就此达成协议。 对于谷歌而言,这可能意味着其

[嵌入式]

谷歌为何自研TPU芯片?团队成员深度披露

现今,Google许多服务,几乎都跟AI有关,举凡是搜寻、地图、照片和翻译等等,这些AI应用服务,在训练学习和推论过程中,都使用到了Google的TPU。Google很早就在数据中心内大量部署TPU,用于加速AI模型训练和推论部署使用,甚至不只自用,后来更当作云端运算服务或提供第三方使用,还将它变成产品销售。 在今年线上台湾人工智慧年会上,Google研究部门软件工程师Cliff Young担任第一天的主题演讲,Cliff Young不只是Google Brain团队核心成员,更是Google TPU晶片主要设计者,一手设计和打造TPU,部署到Google数据中心内,作为AI硬件加速器,用于各种AI模型训练或推论。在加入Go

[半导体设计/制造]

谷歌二代TPU来了、恐侵蚀GPU订单

谷歌 花了十年打造服务器中心,处理每日数十亿次的网络搜寻需求。 如今 谷歌 更进一步,自行研发专属芯片--Tensor Processing Units ( TPU 、见图),加快机器学习脚步,并宣称 TPU 性能优于CPU、GPU。下面就随网络通信小编一起来了解一下相关内容吧。 CNBC、TechCrunch报导, 谷歌 17日在I/O开发者大会,发布第二代 TPU ,处理人工智能(AI)工作。 谷歌推出新版TPU,显示该公司不想倚赖其他业者,打造核心的计算基础设施。 当前谷歌使用Nvidia的GPU处理机器学习工作,倘若谷歌继续自行研发芯片,可能会冲击Nvidia发展。 详细来说,深度学习(Deep Learn

[网络通信]

谷歌推出第二代TPU:性能比传统CPU高出30倍

在今天凌晨举行的谷歌I/O大会上,谷歌除了宣传了安卓8.0之外,更为重要的是着重谈到了人工智能,于是第二代TPU也就应运而生。TPU是谷歌自主研发的一种转为AI运算服务的高性能处理器,其第一代产品已经在AlphaGo这样的人工智能当中使用,主攻运算性能。下面就随嵌入式小编一起来了解一下相关内容吧。 谷歌推出第二代TPU:性能比传统CPU高出30倍 第二代TPU相比较于初代主要是加深了人工智能在学习和推理方面的能力,至于性能的话,全新的谷歌TPU可以达到180TFLOPs的浮点性能,和传统的GPU相比提升15倍,更是CPU浮点性能的30倍。 另外谷歌还推出了一款叫做TPU pod的运算阵列,最多可以包含64颗二代TPU,也就是

[嵌入式]

高通接力谷歌TPU,人工智能芯片竞赛已经展开

作为机器学习的领军人物,Yann LeCun(杨立昆)曾在 25 年前开发过一块名为 ANNA 的人工智能芯片。而现在,构建适用于深度学习的计算芯片已成为所有科技巨头共同的发展目标。那就快随安防电子的智能管理小编详细了解一下吧。 那是 1992 年,LeCun 还供职于贝尔实验室,这座位于纽约市郊的研发机构举世闻名。他和一群研究者们共同设计了一种适用于进行深度神经网络计算的芯片 ANNA,用于高效处理需要分析大量数据的复杂任务,但 ANNA 从未投入市场。随后的二十多年里,神经网络随着计算机性能的不断提升,开始在识别文字、人脸和语音等任务中达到甚至超越了人类水平。但人工智能还远没有达到威胁人类智能的水平,那些用于特定任务的算法,在

[安防电子]

Google发布人工智能芯片TPU 3

TechCrunch 报导,Google CEO Sundar Pichai 8 日在 2018 年 Google I/O 大会发布第三代 TPU(Tensor Processor Unit,TPU3)。他说,TPU 3 机架丛集(Pod)的效能较去年 TPU 2 Pod 高出 8 倍,最高可达 100petaFLOPS。 Venture Beat 报导,Pichai 还提到 TPU 3 效能太强大了,为此旗下数据中心破天荒安装了液体冷却设备。 CNBC 报导,新款 TPU 可协助 Google 改善人工智能(AI)语音辨识度,找出照片与影片当中的特定物体并能理解文字背后所隐藏的情绪。Google 是在 2016 年发布第

[半导体设计/制造]

斯坦福大学Mobile ALOHA 机器人开源资料

斯坦福大学Mobile ALOHA 机器人开源资料 天才程序员:技术狂人如何改变世界

天才程序员:技术狂人如何改变世界 现代雷达系统的信号设计

现代雷达系统的信号设计

BFR340T

BFR340T

京公网安备 11010802033920号

京公网安备 11010802033920号